AIの技術的な話は難しいんじゃないですか?

理解できるか不安です。。。

分からないことあればすぐにテック先生に聞こう!

おう!任せや!何でも聞いてや

AIの構造

AIの構造を理解することは、AIができることとできないことを理解できます。

また、AIが得意なこと苦手なことを理解することで、AIをうまく使えるようになります。

生成AIの舞台裏には、進歩的な技術が数多く存在します。

これらの技術は、コンピュータが人間のように学習し、創造する能力を持つための基盤を形成しています。

以下では、これらの技術を詳しく掘り下げ、その仕組みと応用例を探求します。

ニューラルネットワーク

ニューラルネットワークを一言で説明したらどうなりますか?

ニューラルネットワークは「人間の脳を模倣したデータ処理のAIシステム」やね。

深層学習(Deep Learning)

人間の脳の仕組みにインスパイアされた方法です。

多層ニューラルネットワークを通じて、データから複雑なパターンを学習します。

これは、音声認識や自然言語処理などの複雑なタスクを処理する基盤となっています。

畳み込みニューラルネットワーク(CNN)

CNNは、特に画像処理において重要です。

画像から特徴を抽出し、それらを解析することで、物体認識や顔認識などのタスクを実行します。

再帰型ニューラルネットワーク(RNN)

RNNは、時系列データや順序が重要な情報を扱うのに適しています。

これにより、文章生成や音声認識などが可能になります。

大規模言語モデル(Large Language Models/LLM)

LLM(Large Language Models、大規模言語モデル)は、非常に大量のテキストデータを使って訓練されるAIモデルのことをいいます。

これらのモデルは、言語に関連する様々なタスクをこなす能力を持っています。

LLMの特徴は、その巨大なサイズと多様性です。

膨大な量の文献、ウェブページ、書籍などから学習することで、さまざまな言語パターン、表現、情報を理解し、生成する能力を持つことが可能です。

例えば、文章の生成、質問への回答、テキストの要約、翻訳、さらには特定のテーマに関する詳細な説明など、幅広い用途に使われることが多いです。

LLMは、コンテキストを理解し、論理的かつ関連性のある回答やテキストを生成することができます。

ただ、LLMはその訓練データの質と量に大きく依存するため、偏りや不正確な情報を含む可能性もあります。

だから、LLMを使う際には、その出力を注意深く評価することが重要ですね。

トランスフォーマー

トランスフォーマー(Transformer)は、特に自然言語処理(NLP)の分野で革命を起こした、AIのモデルの一種です。

OpenAIのChatGPTやGoogleのBardなどLLMがAIの常識を変えたといわれている部分はここにあります。

トランスフォーマーの特徴は、主に「アテンション機構」にあります。

アテンション機構って何か一言でいうと?

アテンション機構は「データの重要な部分に焦点を当てるAIの機能」やね。

この機構によって、モデルは入力されたデータの中の重要な部分に「注意」を集中できます。

例えば、文章を処理するときに、特定の単語やフレーズが文脈上重要かどうかを判断します。

従来のモデル(例えばRNNやLSTM)と比べると、トランスフォーマーは以下のような利点があります。

- 並列処理:トランスフォーマーは、データを一度に並列処理できるから、計算が早い。

- 長い依存関係:文章の遠く離れた部分間の関係も捉えることができる。これにより、長い文章でも文脈をより良く理解できる。

- 柔軟性:多様なNLPタスクに適応しやすい。翻訳、要約、質問応答など、幅広い用途に使える。

このトランスフォーマーのモデルは、現在のNLP分野の進展に大きく貢献しており、多くの最先端技術の基盤となっています。

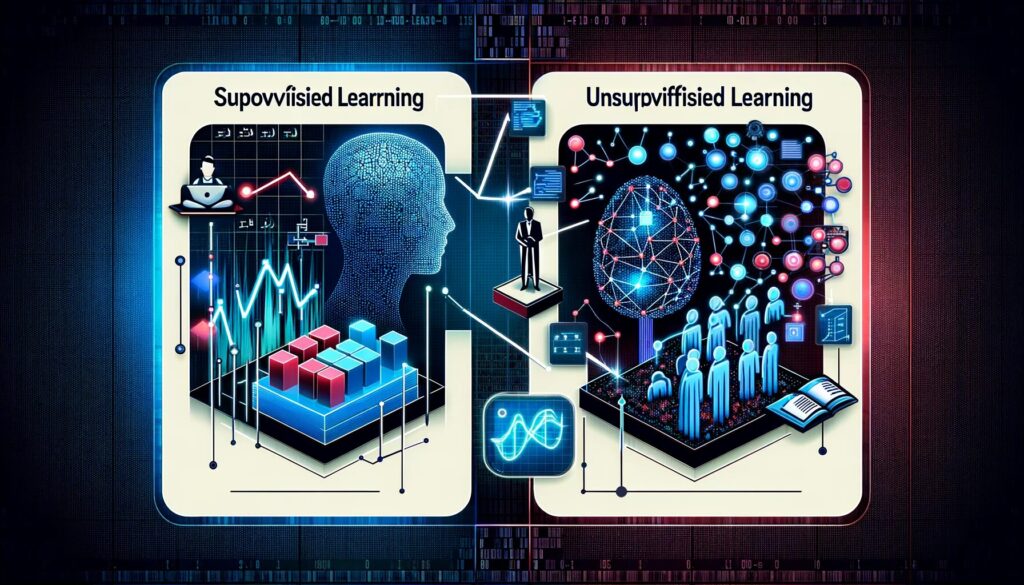

教師あり学習と教師なし学習

教師あり学習

この方法では、AIに「正解」(ラベル付きデータ)を含むトレーニングデータを与えます。

例えば、画像に「犬」や「猫」などとラベル付けして学習させる方法です。

AIはデータとそのラベル(正解)からパターンを学習して、新しいデータに対して正確な予測や分類を行います。

教師あり学習は、分類(Classification)や回帰(Regression)の問題によく使われることが多いです。

教師なし学習

こちらは、ラベルや明確な「正解」なしでデータを学習する方法です。

AIはデータの構造やパターンを自分で見つけ出す方法です。

たとえば、類似のデータをグループにまとめる(クラスタリング)や、データの主要な特徴を見つけ出す(次元削減)などがあります。

教師なし学習は、データの隠れた構造を理解するのに有用です。

たとえば、顧客のセグメント化や異常検知などに使われることが多いです。

強化学習

強化学習(Reinforcement Learning)は、AIが試行錯誤を通じて最適な行動を学習する方法です。

このプロセスは、報酬という形でフィードバックを受けることに基づいています。

具体的には、AI(エージェントと呼ばれる)がある環境の中で行動を選択します。

その行動の結果として、良い結果(目的に適合する行動)を得た場合には報酬が与えられます。

逆に、望ましくない結果の場合には報酬が少ないか、罰(ペナルティ)が与えられることもあります。

強化学習では、この報酬を最大化するようにAIが自分の行動を調整し、最適な戦略や行動パターンを学習していきます。

つまり、経験から学んで、より良い選択をするようになるということです。

この手法は、ゲームやロボットの制御、経済モデルの最適化など、さまざまな分野で使われています。

特に、明確な「正解」がない複雑な問題に対して効果的です。

なんだか子供の育成方法と同じだね

そうやね、強化学習は人間の育成に似てる部分があるで。試行錯誤を通じて最適な行動を学ぶ点や、報酬(または罰)を使って行動を調整する点が、子どもの育成における学習と似てるんや。

GAN(敵対的生成ネットワーク)

GANは、生成器と識別器という2つのネットワークが競い合うことで、リアルな画像やアートワークを生成します。

この技術は、新しい視覚コンテンツの創出や、既存の画像の強化に使われています。

GANには、「ジェネレーター(生成器)」と「ディスクリミネーター(識別器)」の二つの部分があります。

ジェネレーターは新しいデータ(例えば、画像や音声など)を作り出す役割を持ち、ディスクリミネーターはそれが本物か偽物かを見分ける役割をしてます。

例えば、ジェネレーターが絵画を生成したとしたら、ディスクリミネーターはその絵が本物の絵画か、AIが生成したものかを見分けることができます。

ジェネレーターはディスクリミネーターをだますようにどんどん上手になり、ディスクリミネーターもそれを見分ける能力を高めていきます。

この競争を通じて、ジェネレーターはリアルで説得力のあるデータを生成するようになります。

ライバル関係の友達と一緒に高め合う感じだね

そうやね、強化学習は人間の育成に似てる部分があるで。試行錯誤を通じて最適な行動を学ぶ点や、報酬(または罰)を使って行動を調整する点が、子どもの育成における学習と似てるんや。

AIと共存するには

AIの技術を深く理解することは、その可能性と限界を明確に把握する鍵となります。

AIは複雑なデータの分析、パターンの認識、自然言語の処理など、特定のタスクにおいて人間を超越する能力を持っています。

しかし、感情の理解や創造的な判断、倫理的な決断など、人間特有の能力はAIにとっては依然として挑戦的です。

これらの得意分野と苦手分野を認識することで、私たちはAIをより効果的に活用し、人間とAIが協力し合う最適な方法を見出すことができます。

このバランスのとれたアプローチは、AIの真の潜在力を引き出し、私たちの日々の業務、科学研究、さらには社会全体において、より豊かな成果を生み出すための基盤となります。

AIが得意な分野は人間がうまく活用して、AIが苦手な部分は人間の力の入れる場所ってことだね

正解やで!AIの能力と人間の能力を補完し合う形で働くことで、より良い成果を出せるんやね。

コメント